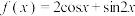

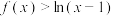

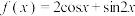

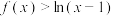

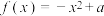

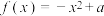

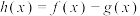

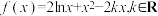

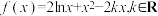

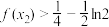

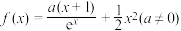

已知函数 .

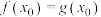

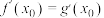

.

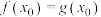

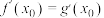

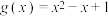

(1)当 时,求

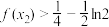

时,求 的最大值;

的最大值;

(2)当 时,,求证:

时,,求证: .

.

.

.(1)当

时,求

时,求 的最大值;

的最大值;(2)当

时,,求证:

时,,求证: .

.

更新时间:2023-12-21 18:36:46

|

相似题推荐

解答题-问答题

|

较难

(0.4)

名校

解题方法

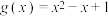

【推荐1】记 ,

, 分别为函数

分别为函数 ,

, 的导函数.若存在

的导函数.若存在 ,满足

,满足 且

且 ,则称

,则称 为函数

为函数 与

与 的一个“好点”.

的一个“好点”.

(1)判断函数 与

与 是否存在“好点”,若存在,求出“好点”;若不存在,请说明珵由;

是否存在“好点”,若存在,求出“好点”;若不存在,请说明珵由;

(2)若函数 与

与 存在“好点”,求实数

存在“好点”,求实数 的值;

的值;

(3)已知函数 ,

, ,若存在实数

,若存在实数 ,使函数

,使函数 与

与 在区间

在区间 内存在“好点”,求实数

内存在“好点”,求实数 的取值范围.

的取值范围.

,

, 分别为函数

分别为函数 ,

, 的导函数.若存在

的导函数.若存在 ,满足

,满足 且

且 ,则称

,则称 为函数

为函数 与

与 的一个“好点”.

的一个“好点”.(1)判断函数

与

与 是否存在“好点”,若存在,求出“好点”;若不存在,请说明珵由;

是否存在“好点”,若存在,求出“好点”;若不存在,请说明珵由;(2)若函数

与

与 存在“好点”,求实数

存在“好点”,求实数 的值;

的值;(3)已知函数

,

, ,若存在实数

,若存在实数 ,使函数

,使函数 与

与 在区间

在区间 内存在“好点”,求实数

内存在“好点”,求实数 的取值范围.

的取值范围.

您最近一年使用:0次

解答题-问答题

|

较难

(0.4)

解题方法

【推荐2】已知定义在 上的两个函数

上的两个函数 ,

, .

.

(1)求函数 的最小值;

的最小值;

(2)设直线 与曲线

与曲线 ,

, 分别交于A,B两点,求

分别交于A,B两点,求 的最小值.

的最小值.

上的两个函数

上的两个函数 ,

, .

.(1)求函数

的最小值;

的最小值;(2)设直线

与曲线

与曲线 ,

, 分别交于A,B两点,求

分别交于A,B两点,求 的最小值.

的最小值.

您最近一年使用:0次

解答题-问答题

|

较难

(0.4)

名校

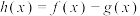

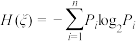

【推荐3】在信息论中,熵(entropy)是接收的每条消息中包含的信息的平均量,又被称为信息熵、信源熵、平均自信息量.这里,“消息”代表来自分布或数据流中的事件、样本或特征.(熵最好理解为不确定性的量度而不是确定性的量度,因为越随机的信源的熵越大)来自信源的另一个特征是样本的概率分布.这里的想法是,比较不可能发生的事情,当它发生了,会提供更多的信息.由于一些其他的原因,把信息(熵)定义为概率分布的对数的相反数是有道理的.事件的概率分布和每个事件的信息量构成了一个随机变量,这个随机变量的均值(即期望)就是这个分布产生的信息量的平均值(即熵).熵的单位通常为比特,但也用 、

、 、

、 计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1

计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1 的信息,而掷

的信息,而掷 次就为

次就为 位.更一般地,你需要用

位.更一般地,你需要用 位来表示一个可以取

位来表示一个可以取 个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量

个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量 所有取值为

所有取值为 ,定义

,定义 的信息熵

的信息熵 ,(

,( ,

, ).

).

(1)若 ,试探索

,试探索 的信息熵关于

的信息熵关于 的解析式,并求其最大值;

的解析式,并求其最大值;

(2)若 ,

, (

( ),求此时的信息熵.

),求此时的信息熵.

、

、 、

、 计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1

计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1 的信息,而掷

的信息,而掷 次就为

次就为 位.更一般地,你需要用

位.更一般地,你需要用 位来表示一个可以取

位来表示一个可以取 个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量

个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量 所有取值为

所有取值为 ,定义

,定义 的信息熵

的信息熵 ,(

,( ,

, ).

).(1)若

,试探索

,试探索 的信息熵关于

的信息熵关于 的解析式,并求其最大值;

的解析式,并求其最大值;(2)若

,

, (

( ),求此时的信息熵.

),求此时的信息熵.

您最近一年使用:0次

解答题-证明题

|

较难

(0.4)

名校

解题方法

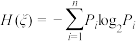

【推荐1】已知函数 .

.

(1)当 时,求曲线

时,求曲线 在点

在点 处的切线方程;

处的切线方程;

(2)若函数 有两个极值点

有两个极值点 ,且

,且 .

.

①求 的取值范围;

的取值范围;

②求证: .

.

.

.(1)当

时,求曲线

时,求曲线 在点

在点 处的切线方程;

处的切线方程;(2)若函数

有两个极值点

有两个极值点 ,且

,且 .

.①求

的取值范围;

的取值范围;②求证:

.

.

您最近一年使用:0次

解答题-证明题

|

较难

(0.4)

【推荐2】设函数 ,

, .

.

(1)若曲线 在点

在点 处的切线与直线

处的切线与直线 垂直,求

垂直,求 的值;

的值;

(2)求函数 的单调区间;

的单调区间;

(3)若函数 有两个极值点

有两个极值点 ,

, ,且

,且 ,求证:

,求证: .

.

,

, .

.(1)若曲线

在点

在点 处的切线与直线

处的切线与直线 垂直,求

垂直,求 的值;

的值;(2)求函数

的单调区间;

的单调区间;(3)若函数

有两个极值点

有两个极值点 ,

, ,且

,且 ,求证:

,求证: .

.

您最近一年使用:0次

.

. 时,求曲线

时,求曲线 处的切线方程;

处的切线方程; ,并指出

,并指出