名校

解题方法

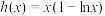

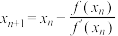

1 . 牛顿在《流数法》一书中,给出了代数方程的一种数值解法——牛顿法.具体做法如下:如图,设r是 的根,首先选取

的根,首先选取 作为r的初始近似值,若

作为r的初始近似值,若 在点

在点 处的切线与

处的切线与 轴相交于点

轴相交于点 ,称

,称 是r的一次近似值;用

是r的一次近似值;用 替代

替代 重复上面的过程,得到

重复上面的过程,得到 ,称

,称 是r的二次近似值;一直重复,可得到一列数:

是r的二次近似值;一直重复,可得到一列数: .在一定精确度下,用四舍五入法取值,当

.在一定精确度下,用四舍五入法取值,当 近似值相等时,该值即作为函数

近似值相等时,该值即作为函数 的一个零点

的一个零点 .

. ,当

,当 时,求方程

时,求方程 的二次近似值(保留到小数点后两位);

的二次近似值(保留到小数点后两位);

(2)牛顿法中蕴含了“以直代曲”的数学思想,直线常常取为曲线的切线或割线,求函数 在点

在点 处的切线,并证明:

处的切线,并证明: ;

;

(3)若 ,若关于

,若关于 的方程

的方程 的两个根分别为

的两个根分别为 ,证明:

,证明: .

.

的根,首先选取

的根,首先选取 作为r的初始近似值,若

作为r的初始近似值,若 在点

在点 处的切线与

处的切线与 轴相交于点

轴相交于点 ,称

,称 是r的一次近似值;用

是r的一次近似值;用 替代

替代 重复上面的过程,得到

重复上面的过程,得到 ,称

,称 是r的二次近似值;一直重复,可得到一列数:

是r的二次近似值;一直重复,可得到一列数: .在一定精确度下,用四舍五入法取值,当

.在一定精确度下,用四舍五入法取值,当 近似值相等时,该值即作为函数

近似值相等时,该值即作为函数 的一个零点

的一个零点 .

.

,当

,当 时,求方程

时,求方程 的二次近似值(保留到小数点后两位);

的二次近似值(保留到小数点后两位);(2)牛顿法中蕴含了“以直代曲”的数学思想,直线常常取为曲线的切线或割线,求函数

在点

在点 处的切线,并证明:

处的切线,并证明: ;

;(3)若

,若关于

,若关于 的方程

的方程 的两个根分别为

的两个根分别为 ,证明:

,证明: .

.

您最近一年使用:0次

2024-04-24更新

|

767次组卷

|

3卷引用:河北省衡水市第二中学2023-2024学年高二下学期5月学科素养检测(二调)数学试题

名校

2 . 英国著名物理学家牛顿用“作切线”的方法求函数零点.已知二次函数 有两个不相等的实根

有两个不相等的实根 ,其中

,其中 .在函数

.在函数 图象上横坐标为

图象上横坐标为 的点处作曲线

的点处作曲线 的切线,切线与

的切线,切线与 轴交点的横坐标为

轴交点的横坐标为 ;用

;用 代替

代替 ,重复以上的过程得到

,重复以上的过程得到 ;一直下去,得到数列

;一直下去,得到数列 .记

.记 ,且

,且 ,

, ,下列说法正确的是( )

,下列说法正确的是( )

有两个不相等的实根

有两个不相等的实根 ,其中

,其中 .在函数

.在函数 图象上横坐标为

图象上横坐标为 的点处作曲线

的点处作曲线 的切线,切线与

的切线,切线与 轴交点的横坐标为

轴交点的横坐标为 ;用

;用 代替

代替 ,重复以上的过程得到

,重复以上的过程得到 ;一直下去,得到数列

;一直下去,得到数列 .记

.记 ,且

,且 ,

, ,下列说法正确的是( )

,下列说法正确的是( )A. (其中 (其中 ) ) | B.数列 是递减数列 是递减数列 |

C. | D.数列 的前 的前 项和 项和 |

您最近一年使用:0次

2024-02-21更新

|

3059次组卷

|

5卷引用:信息必刷卷05

(已下线)信息必刷卷05广东省东莞中学、广州二中、惠州一中、深圳实验、珠海一中、中山纪念中学2024届高三第四次六校联考数学试题辽宁省沈阳市辽宁实验中学2024届高三下学期高考适应性测试(二)数学试题(已下线)压轴题05数列压轴题15题型汇总-1江苏省常州市华罗庚中学2024届高三下学期4月冲刺测试一数学试卷

名校

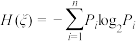

3 . 在信息论中,熵(entropy)是接收的每条消息中包含的信息的平均量,又被称为信息熵、信源熵、平均自信息量.这里,“消息”代表来自分布或数据流中的事件、样本或特征.(熵最好理解为不确定性的量度而不是确定性的量度,因为越随机的信源的熵越大)来自信源的另一个特征是样本的概率分布.这里的想法是,比较不可能发生的事情,当它发生了,会提供更多的信息.由于一些其他的原因,把信息(熵)定义为概率分布的对数的相反数是有道理的.事件的概率分布和每个事件的信息量构成了一个随机变量,这个随机变量的均值(即期望)就是这个分布产生的信息量的平均值(即熵).熵的单位通常为比特,但也用 、

、 、

、 计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1

计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1 的信息,而掷

的信息,而掷 次就为

次就为 位.更一般地,你需要用

位.更一般地,你需要用 位来表示一个可以取

位来表示一个可以取 个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量

个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量 所有取值为

所有取值为 ,定义

,定义 的信息熵

的信息熵 ,(

,( ,

, ).

).

(1)若 ,试探索

,试探索 的信息熵关于

的信息熵关于 的解析式,并求其最大值;

的解析式,并求其最大值;

(2)若 ,

, (

( ),求此时的信息熵.

),求此时的信息熵.

、

、 、

、 计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1

计量,取决于定义用到对数的底.采用概率分布的对数作为信息的量度的原因是其可加性.例如,投掷一次硬币提供了1 的信息,而掷

的信息,而掷 次就为

次就为 位.更一般地,你需要用

位.更一般地,你需要用 位来表示一个可以取

位来表示一个可以取 个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量

个值的变量.在1948年,克劳德•艾尔伍德•香农将热力学的熵,引入到信息论,因此它又被称为香农滳.而正是信息熵的发现,使得1871年由英国物理学家詹姆斯•麦克斯韦为了说明违反热力学第二定律的可能性而设想的麦克斯韦妖理论被推翻.设随机变量 所有取值为

所有取值为 ,定义

,定义 的信息熵

的信息熵 ,(

,( ,

, ).

).(1)若

,试探索

,试探索 的信息熵关于

的信息熵关于 的解析式,并求其最大值;

的解析式,并求其最大值;(2)若

,

, (

( ),求此时的信息熵.

),求此时的信息熵.

您最近一年使用:0次

2024-01-16更新

|

1851次组卷

|

8卷引用:河北省2024届高三上学期大数据应用调研联合测评数学试题

河北省2024届高三上学期大数据应用调研联合测评数学试题河北省石家庄市十八中2024届高三上学期1月联考数学试题河北省衡水市武邑中学2023-2024学年高二下学期第二次月考数学试题(已下线)考点15 数列中的数学文化 2024届高考数学考点总动员【练】广东省中山市中山纪念中学2024届高三上学期第三次模拟测试数学试题(已下线)压轴题概率与统计新定义题(九省联考第19题模式)练(已下线)微考点8-1 新高考新题型19题新定义题型精选(已下线)专题22 新高考新题型第19题新定义压轴解答题归纳(9大核心考点)(讲义)

名校

解题方法

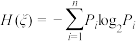

4 . 英国著名物理学家牛顿用“作切线”的方法求函数零点时,给出的“牛顿数列”在航空航天中应用广泛,若数列 满足

满足 ,则称数列

,则称数列 为牛顿数列

为牛顿数列 如果函数

如果函数 ,数列

,数列 为牛顿数列,设

为牛顿数列,设 ,且

,且 ,

, 则

则

___________

满足

满足 ,则称数列

,则称数列 为牛顿数列

为牛顿数列 如果函数

如果函数 ,数列

,数列 为牛顿数列,设

为牛顿数列,设 ,且

,且 ,

, 则

则

您最近一年使用:0次

名校

解题方法

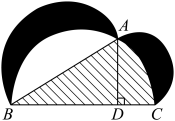

5 . 如图来自古希腊数学家希波克拉底所研究的几何图形,此图由三个半圆构成,三个半圆的直径分别为直角三角形 的斜边

的斜边 、直角边

、直角边 、直角边

、直角边 ,

, 的三边所围成的区域.若

的三边所围成的区域.若 ,过点

,过点 作

作 于

于 ,当

,当 面积最大时,黑色区域的面积为

面积最大时,黑色区域的面积为_________ .

的斜边

的斜边 、直角边

、直角边 、直角边

、直角边 ,

, 的三边所围成的区域.若

的三边所围成的区域.若 ,过点

,过点 作

作 于

于 ,当

,当 面积最大时,黑色区域的面积为

面积最大时,黑色区域的面积为

您最近一年使用:0次